Inteligencia artificial para niños

La inteligencia artificial (abreviado: IA) es un campo de estudio en las ciencias de la computación. Se trata de crear máquinas o programas de computadora que puedan imitar la inteligencia humana. Estas máquinas aprenden de la experiencia, se adaptan a situaciones nuevas y realizan tareas que normalmente hacen los humanos. Algunos ejemplos son reconocer voces, tomar decisiones, traducir idiomas o "ver" imágenes.

Hoy en día, la inteligencia artificial incluye muchos campos. Desde el aprendizaje y la percepción general, hasta tareas más específicas. Por ejemplo, el reconocimiento de voz, jugar al ajedrez, resolver problemas de matemáticas, escribir poesía o ayudar en el diagnóstico médico. La IA puede automatizar tareas que requieren pensamiento, por lo que es útil en casi cualquier actividad humana. Además, la IA mejora constantemente gracias a tecnologías como el aprendizaje profundo y las redes neuronales artificiales.

Las inteligencias artificiales aprenden y mejoran de diferentes maneras. Algunas usan algoritmos sencillos. Otras conectan complejas redes neuronales artificiales que se parecen a las conexiones del cerebro humano. Aprenden con métodos como el aprendizaje automático, el aprendizaje por refuerzo y el aprendizaje profundo.

El desarrollo de la IA también ha creado nuevos campos de estudio. Por ejemplo, la roboética y la ética de las máquinas. Estas áreas analizan cómo la IA afecta la vida y cómo debemos usarla de forma responsable. También establecen reglas para el comportamiento de las máquinas.

La IA se clasifica en dos tipos principales. La inteligencia artificial débil es la que existe actualmente. Se encarga de tareas específicas. La inteligencia artificial fuerte (o inteligencia artificial general) sería una IA que superara las capacidades humanas. Algunos expertos creen que si se alcanza este nivel, podría surgir una "singularidad tecnológica". Esto significa que una tecnología sería tan avanzada que podría mejorarse a sí misma sin control humano.

Algunas inteligencias artificiales conocidas son los asistentes virtuales como Alexa, el Asistente de Google o Siri. También los traductores automáticos como el Traductor de Google. Los sistemas de recomendación de plataformas como YouTube también usan IA. Otros ejemplos son los programas de ajedrez como Stockfish y AlphaZero, los chatbots como ChatGPT, y los creadores de arte de inteligencia artificial como Midjourney y Dall-e. La IA también se usa en vehículos autónomos como los de Tesla.

Contenido

- ¿Qué es la inteligencia artificial?

- Tipos de inteligencia artificial

- Escuelas de pensamiento

- Historia de la inteligencia artificial

- Tendencias de la IA

- Impacto social y ético de la IA

- Regulación de la IA

- Objetivos de la inteligencia artificial

- Importancia de la inteligencia artificial

- Normativa para el uso de la IA en la educación

- Aprendizaje automático y aprendizaje profundo

- Propiedad intelectual de la inteligencia artificial

- La IA en la cultura popular

- Véase también

- Galería de imágenes

¿Qué es la inteligencia artificial?

En 2019, la UNESCO definió la inteligencia artificial como un campo que permite a las máquinas imitar algunas funciones de la inteligencia humana. Esto incluye la percepción, el aprendizaje, el razonamiento, la resolución de problemas, la comunicación y hasta la creación de trabajos artísticos.

En el lenguaje común, decimos que una máquina tiene "inteligencia artificial" cuando imita habilidades que asociamos con el pensamiento humano. Por ejemplo, "percibir", "razonar", "aprender" y "resolver problemas". Andreas Kaplan y Michael Haenlein la definen como la capacidad de un sistema para entender datos externos, aprender de ellos y usar ese conocimiento para lograr metas.

A medida que las máquinas se vuelven más capaces, algunas tecnologías que antes se consideraban IA, ahora son comunes. Por ejemplo, el reconocimiento óptico de caracteres (OCR) ya no se ve como IA. Sin embargo, los sistemas de conducción autónoma o los que juegan ajedrez o Go sí se clasifican como IA.

La inteligencia artificial es una forma nueva de resolver problemas. Incluye sistemas que pueden aprender y tomar decisiones como lo haría un ser humano. Según Takeyas (2007), la IA es una parte de las ciencias de la computación que estudia cómo las computadoras pueden realizar actividades humanas basadas en el razonamiento y el comportamiento.

En 1956, John McCarthy creó la expresión "inteligencia artificial". La definió como "la ciencia y el ingenio de hacer máquinas inteligentes, especialmente programas de computadora inteligentes".

La IA también puede obtener información de sensores físicos o mecánicos en máquinas, o de datos en computadoras. Varios ejemplos se encuentran en el control de sistemas, la planificación automática, la capacidad de responder a preguntas y el reconocimiento de patrones. Los sistemas de IA son parte de la vida diaria en campos como la economía, la medicina, la ingeniería, el transporte y las comunicaciones. También se usan en programas informáticos y videojuegos.

La inteligencia artificial sigue creciendo en plataformas digitales. Por ejemplo, existe una herramienta laboral llamada SIVIUM que ayuda a las personas a postularse a ofertas de trabajo de forma automática.

Tipos de inteligencia artificial

Stuart J. Russell y Peter Norvig identifican varios tipos de inteligencia artificial:

- Los sistemas que piensan como humanos: Intentan imitar el pensamiento humano, como las redes neuronales artificiales. Automatizan actividades como la toma de decisiones y la resolución de problemas.

- Los sistemas que actúan como humanos: Intentan comportarse como humanos. Por ejemplo, la robótica estudia cómo las computadoras pueden hacer tareas que los humanos hacen mejor.

- Los sistemas que piensan racionalmente: Usan la lógica para imitar el pensamiento racional humano, como los sistemas expertos.

- Los sistemas que actúan racionalmente: Intentan imitar el comportamiento humano de forma lógica, como los agentes inteligentes.

Inteligencia artificial generativa

La inteligencia artificial generativa es un tipo de IA que puede crear texto, imágenes u otros contenidos. Lo hace a partir de instrucciones de texto llamadas "prompts". Estos modelos aprenden de grandes cantidades de datos y luego generan cosas nuevas con características similares.

Algunos sistemas de IA generativa importantes son ChatGPT y Microsoft Copilot, creados por OpenAI. También Gemini de Google y Claude de Anthropic. Otros modelos generativos de IA son los sistemas de arte de inteligencia artificial como Stable Diffusion, Midjourney y DALL-E, que crean imágenes. La IA generativa puede crear texto, código, imágenes, videos, música y voces.

Inteligencia artificial fuerte

La Inteligencia artificial fuerte (IGA) es un tipo de IA que, si existiera, igualaría o superaría la inteligencia humana promedio. Una IGA podría aprender a hacer cualquier tarea intelectual que los humanos o animales puedan realizar. Algunos creen que podría ser posible en el futuro, mientras que otros piensan que nunca se logrará.

Inteligencia artificial explicable

La inteligencia artificial explicable se refiere a métodos que permiten a los humanos entender cómo la IA toma sus decisiones y hace sus predicciones.

Inteligencia artificial amigable

La inteligencia artificial amigable es una IA fuerte hipotética que tendría un efecto positivo en la humanidad. Se usa el término "amigable" para referirse a agentes que son seguros y útiles. Este concepto es importante cuando se habla de IA que puede mejorarse a sí misma muy rápidamente, ya que su impacto en la sociedad humana sería enorme y difícil de controlar.

Inteligencia artificial multimodal

La inteligencia artificial multimodal puede procesar e integrar datos de diferentes tipos. Por ejemplo, texto, imágenes, audio y video. Esto le permite entender una situación de forma más completa. Se inspira en cómo los humanos usamos varios sentidos para interactuar con el mundo.

Inteligencia artificial cuántica

La inteligencia artificial cuántica es un campo que busca crear algoritmos cuánticos. Estos algoritmos mejorarían las tareas de la IA, incluyendo el aprendizaje automático.

Escuelas de pensamiento

La IA se divide en dos grandes enfoques:

- La inteligencia artificial convencional.

- La inteligencia computacional.

Inteligencia artificial convencional

También se le llama IA simbólica-deductiva. Se basa en el análisis de cómo los humanos resuelven problemas.

- Razonamiento basado en casos: Ayuda a tomar decisiones usando soluciones de problemas similares que ya se resolvieron.

- Sistemas expertos: Encuentran soluciones usando conocimientos previos y reglas.

- Redes bayesianas: Proponen soluciones usando probabilidades.

- Inteligencia artificial basada en comportamientos: Esta IA puede controlarse y mejorarse a sí misma.

- Smart process management: Facilita la toma de decisiones complejas, como lo haría un experto.

Inteligencia artificial computacional

La inteligencia computacional (también conocida como IA subsimbólica-inductiva) implica el aprendizaje interactivo. El aprendizaje se basa en datos reales.

Su objetivo es entender cómo funciona el comportamiento inteligente en sistemas naturales o artificiales. También busca crear métodos para diseñar sistemas inteligentes.

Historia de la inteligencia artificial

- La expresión "inteligencia artificial" fue creada en 1956 durante la Conferencia de Dartmouth. Sin embargo, ya se había trabajado en ideas similares durante cinco años.

- Las ideas más antiguas vienen de los griegos. Aristóteles (384-322 a. C.) describió reglas para el razonamiento. Ctesibio de Alejandría (250 a. C.) construyó la primera máquina autocontrolada.

- En 1315, Ramon Llull pensó que el razonamiento podría hacerse de forma artificial.

- En 1840, Ada Lovelace imaginó que las máquinas podrían hacer más que solo cálculos, dando una idea del software.

- En 1912, Leonardo Torres Quevedo creó un autómata que jugaba ajedrez.

- En 1936, Alan Turing diseñó una "Máquina universal" que mostró cómo un dispositivo físico podía realizar cualquier cálculo.

- En 1943, Warren McCulloch y Walter Pitts presentaron su modelo de neuronas artificiales.

- A principios de los años 50, Alan Turing hizo importantes avances.

- En 1955, Herbert Simon, Allen Newell y Joseph Carl Shaw crearon el primer lenguaje de programación para resolver problemas, el IPL-11. Un año después, desarrollaron el LogicTheorist, que podía demostrar teoremas matemáticos.

- En 1956, John McCarthy, Marvin Minsky y Claude Shannon acuñaron el término "inteligencia artificial" en la Conferencia de Dartmouth.

- En 1957, Newell y Simon desarrollaron el General Problem Solver (GPS), un sistema para resolver problemas.

- En 1958, John McCarthy creó el lenguaje LISP en el MIT, el primer lenguaje para procesar símbolos.

- En 1959, Rosenblatt presentó el "perceptrón".

- A finales de los 50 y principios de los 60, Robert K. Lindsay desarrolló "Sad Sam", un programa que leía oraciones en inglés y sacaba conclusiones.

- En 1963, Quillian desarrolló las redes semánticas para representar el conocimiento.

- En 1964, Bertrand Raphael construyó el sistema SIR, que podía inferir conocimiento.

- A mediados de los años 60, surgieron los sistemas expertos, que predecían soluciones. Por ejemplo, DENDRAL (1965) ayudaba a químicos con estructuras químicas.

- Entre 1968 y 1970, Terry Winograd desarrolló SHRDLU, que permitía interactuar con un robot.

- Entre 1966 y 1972, el Artificial Intelligence Center desarrolló el "Robot Shakey", el primer robot inteligente con visión artificial.

- En 1968, Marvin Minsky publicó Semantic Information Processing.

- En 1968, Seymour Papert, Danny Bobrow y Wally Feurzeig desarrollaron el lenguaje de programación LOGO.

- En 1969, Alan Kay desarrolló el lenguaje Smalltalk.

- En 1973, Alain Colmenauer y su equipo crearon PROLOG, un lenguaje muy usado en IA.

- En 1973, Shank y Abelson desarrollaron los guiones o scripts.

- En 1974, Edward Shortliffe escribió su tesis con MYCIN, un sistema experto que ayudaba a médicos a diagnosticar infecciones.

- En los años 70 y 80, creció el uso de sistemas expertos como MYCIN y R1/XCON.

- En 1981, Kazuhiro Fuchi anunció el proyecto japonés de la quinta generación de computadoras.

- En 1986, McClelland y Rumelhart publicaron sobre Redes Neuronales.

- En 1987, Hitachi desarrolló el Sendai Subway 1000, el primer tren autónomo.

- En 1988, se establecieron los lenguajes Orientados a Objetos.

- En 1997, Gari Kaspárov, campeón mundial de ajedrez, perdió contra la computadora Deep Blue.

- En 2009, ya había sistemas inteligentes que detectaban emociones para interactuar con niños.

- En 2011, IBM desarrolló Watson, un superordenador que ganó el concurso Jeopardy!.

- En 2016, un programa informático ganó a un campeón de Go.

- En 2017, AlphaGo de DeepMind derrotó al campeón mundial de Go, Lee Sedol. Ese mismo año, AlphaZero derrotó a Stockfish, el mejor motor de ajedrez, después de solo 4 horas de entrenamiento.

- En 2017, ingenieros de Google inventaron la arquitectura de transformador, que dio origen a una nueva generación de modelos de lenguaje grandes, como GPT de OpenAI.

- En 2018, LG Electronics lanzó el primer televisor con inteligencia artificial.

- En 2019, Google creó un Doodle que, con IA, completaba melodías de Johann Sebastian Bach.

- A finales de 2022, se lanzó ChatGPT, una inteligencia artificial generativa que escribe textos y responde preguntas. Rápidamente alcanzó millones de usuarios. Aunque a veces puede dar información incorrecta, su redacción es muy buena.

- En 2023, las fotos generadas por IA alcanzaron un nivel de realismo que las hacía parecer reales. Una imagen del papa Francisco con un abrigo blanco generada por Midjourney se hizo muy famosa.

Tendencias de la IA

En 2024, se esperan grandes avances en la IA:

- Aprendizaje automático y profundo: Las máquinas aprenderán de forma más eficiente de grandes cantidades de datos, mejorando el procesamiento del lenguaje, la visión por computadora y la toma de decisiones.

- Procesamiento del Lenguaje Natural (PLN): Las máquinas entenderán y responderán al lenguaje humano de forma más natural, abriendo nuevas posibilidades en atención al cliente y creación de contenido.

- Analítica predictiva y prescriptiva: Se usarán datos para prever el futuro y recomendar acciones, ayudando a las organizaciones a anticipar problemas.

- Integración del Internet de las cosas (IoT) y la IA: Las máquinas recopilarán y analizarán datos en tiempo real para tomar decisiones autónomas y mejorar la eficiencia.

- IA Generativa: Será más accesible para todos, permitiendo crear chatbots personalizados y otros modelos generativos.

Impacto social y ético de la IA

Con la posibilidad de crear máquinas inteligentes, es importante pensar en la ética para asegurar que no causen daño a los humanos, a otros seres vivos o incluso a las propias máquinas. Así surgió la ética de la inteligencia artificial, que se divide en dos ramas: la roboética, que estudia cómo los humanos tratan a los robots, y la ética de las máquinas, que estudia el comportamiento de los robots hacia los humanos.

El rápido avance de la IA en el siglo XXI también tiene un gran impacto en otros campos. En la economía mundial, la automatización industrial a veces reemplaza el trabajo humano. Con la IA, podría ocurrir algo similar, especialmente en tareas que requieren inteligencia humana. Isaac Asimov exploró esto en su cuento ¡Cómo se divertían!, donde imaginaba máquinas inteligentes enseñando a niños en lugar de profesores. Asimov también creó las tres leyes de la robótica, que aparecieron por primera vez en su relato Círculo vicioso (1942):

- Primera Ley

- Un robot no hará daño a un ser humano ni permitirá que un ser humano sufra daño.

- Segunda Ley

- Un robot debe cumplir las órdenes dadas por los seres humanos, excepto si entran en conflicto con la primera ley.

- Tercera Ley

- Un robot debe proteger su propia existencia, siempre que esta protección no entre en conflicto con la primera o la segunda ley.

Otras obras de ciencia ficción como las películas Yo, robot o A.I. Inteligencia Artificial también exploran preguntas éticas sobre la Inteligencia artificial fuerte. Por ejemplo, si los robots podrían tener autoconsciencia o sentimientos, o si podrían tomar decisiones por sí mismos. La famosa saga de Terminator muestra máquinas que se vuelven muy poderosas y entran en conflicto con los humanos.

Regulación de la IA

El Derecho es muy importante para el uso y desarrollo de la IA. Las leyes establecen reglas para proteger a las personas y asegurar el bienestar social. Ayudan a aprovechar los beneficios de la IA y a reducir sus riesgos. Actualmente, no hay leyes específicas que regulen directamente la IA. Sin embargo, la Comisión Europea propuso en 2021 un Reglamento para la regulación armonizada de la inteligencia artificial en la Unión Europea.

En marzo de 2023, cientos de líderes empresariales como Elon Musk y Steve Wozniak (cofundador de Apple), junto con intelectuales e investigadores, firmaron una carta abierta. En ella, advertían sobre los peligros de la falta de regulación de la IA, especialmente de empresas como OpenAI (creadora de ChatGPT). Pidieron una pausa de al menos 6 meses en los experimentos más potentes, hasta que se logre un acuerdo internacional para que estos sistemas sean más seguros y confiables.

Dos meses después, en mayo, 350 ejecutivos y expertos en IA firmaron un nuevo manifiesto. Alertaron que la IA avanzada sin regular podría representar un riesgo para la humanidad. Sugirieron que "mitigar el riesgo de la IA debería ser una prioridad mundial, junto con otros grandes desafíos globales". Entre los firmantes estaban líderes de OpenAI, Microsoft y Google DeepMind.

Algunos expertos han empezado a considerar si las inteligencias artificiales avanzadas podrían tener derechos y responsabilidades legales, como pagar impuestos por los bienes o servicios digitales que producen. Esto se inspira en figuras legales como las empresas, que no son humanas pero pueden actuar legalmente. Se propone que los ingresos generados por IA, como los bots creativos o vehículos autónomos, puedan destinarse a fondos o impuestos. Esto ayudaría a manejar el impacto económico de la IA y a distribuir sus beneficios en una sociedad cada vez más digital.

Esta idea no significa que la IA sea igual a los humanos. Más bien, busca crear un marco legal para manejar las consecuencias de la producción autónoma de la IA. Por ejemplo, los ingresos de un bot que crea arte podrían usarse para un fondo de garantía. Esto ayuda a proteger la economía humana y a aclarar las responsabilidades legales.

Objetivos de la inteligencia artificial

Razonamiento y resolución de problemas

Los primeros investigadores crearon algoritmos que imitaban el razonamiento humano paso a paso para resolver acertijos. Más tarde, la IA desarrolló métodos para manejar información incierta, usando ideas de probabilidad.

Estos algoritmos no eran suficientes para problemas grandes porque se volvían muy lentos. Se dieron cuenta de que los humanos rara vez usan un razonamiento paso a paso; en cambio, resuelven la mayoría de los problemas con juicios rápidos e intuitivos.

Representación del conocimiento

La representación del conocimiento es clave para la IA clásica. Algunos "sistemas expertos" intentan recopilar el conocimiento de especialistas en un área. Otros proyectos buscan reunir el "conocimiento de sentido común" que una persona promedio tiene sobre el mundo en una base de datos.

Esta base de conocimiento incluiría información sobre objetos, propiedades, categorías, relaciones, situaciones, eventos, tiempo, causas y efectos. También, lo que sabemos sobre lo que otras personas saben.

Planificación

Otro objetivo de la IA es poder establecer metas y alcanzarlas. Para esto, necesitan "ver" el futuro. Es decir, tener una representación del estado del mundo y predecir cómo sus acciones lo cambiarán. Así pueden tomar decisiones que maximicen el "valor" de las opciones disponibles.

En problemas de planificación simples, la IA puede asumir que es el único sistema actuando. Pero si hay otros, la IA necesita razonar con incertidumbre. Esto significa que debe evaluar su entorno, hacer predicciones y adaptarse según sus evaluaciones. La planificación con múltiples agentes usa la cooperación y la competencia de varios sistemas para lograr un objetivo.

Aprendizaje

El aprendizaje automático es un concepto fundamental de la IA. Consiste en crear algoritmos que mejoran automáticamente con la experiencia.

El aprendizaje no supervisado es la capacidad de encontrar patrones en datos sin que un humano los etiquete primero. El aprendizaje supervisado incluye la clasificación y la regresión. Esto requiere que un humano etiquete los datos de entrada. La clasificación se usa para determinar a qué categoría pertenece algo. La regresión intenta encontrar una función que describa la relación entre entradas y salidas.

Procesamiento de lenguajes naturales

El procesamiento del lenguaje natural permite a las máquinas leer y comprender el lenguaje humano. Un sistema eficaz de PLN permitiría interfaces de usuario de lenguaje natural y la adquisición de conocimiento directamente de textos escritos por humanos. Algunas aplicaciones sencillas incluyen la recuperación de información, la minería de textos, la respuesta a preguntas y la traducción automática.

Muchos enfoques usan la frecuencia de las palabras para entender la estructura del texto. Las estrategias de "detección de palabras clave" son populares, pero pueden fallar si una palabra no está literalmente en el texto (por ejemplo, buscar "perro" y no encontrar "caniche"). Los enfoques estadísticos combinan varias estrategias y logran buena precisión. El objetivo final es que la IA entienda el razonamiento de sentido común. En 2019, las arquitecturas de aprendizaje profundo podían generar texto coherente.

Percepción

La percepción de la máquina es la capacidad de usar información de sensores (como cámaras, micrófonos o radares) para entender el mundo. Las aplicaciones incluyen el reconocimiento de voz, el reconocimiento facial y el reconocimiento de objetos. La visión artificial es la capacidad de analizar información visual, que a menudo es ambigua. Por ejemplo, un objeto lejano puede parecer pequeño, pero la IA debe juzgar la probabilidad de que sea un objeto normal lejos o un objeto gigante cerca.

Importancia de la inteligencia artificial

La IA es muy importante porque tiene muchas aplicaciones. Desde automatizar tareas repetitivas hasta crear sistemas avanzados de asistencia médica, detectar fraudes y mejorar procesos en empresas. En muchos casos, la IA puede hacer cosas que los humanos no pueden, como procesar grandes cantidades de datos y encontrar patrones que serían difíciles de detectar de otra manera.

La IA ayuda a automatizar el aprendizaje y el descubrimiento de datos. Realiza tareas computarizadas frecuentes de forma confiable, aunque necesita ayuda humana para configurarse. Analiza datos más a fondo y añade inteligencia a los productos. Tiene gran precisión gracias a las redes neuronales profundas; por ejemplo, en medicina puede ayudar a detectar enfermedades con imágenes por resonancia magnética. Se adapta con algoritmos de aprendizaje progresivo y encuentra patrones en los datos. La IA aprovecha al máximo los datos.

Una de las principales razones por las que la IA es importante es que puede automatizar tareas repetitivas. Esto libera tiempo y recursos para que las personas se enfoquen en tareas más creativas y valiosas. Por ejemplo, la IA puede ayudar a las empresas a automatizar tareas administrativas, lo que reduce costos y mejora la eficiencia. También puede ayudar a los trabajadores a realizar tareas más complejas, como el diseño y la planificación.

Otra razón es que la IA puede ayudar a las empresas a tomar decisiones informadas. Puede procesar grandes cantidades de datos y dar información valiosa para las decisiones de negocio. Esto ayuda a identificar oportunidades, predecir tendencias y mejorar la eficiencia. Además, la IA puede ayudar a los trabajadores a tomar decisiones en tiempo real, como en la atención médica, donde ayuda a los médicos a identificar enfermedades y personalizar tratamientos.

La IA también es importante en la ciberseguridad. Puede ayudar a detectar y prevenir amenazas, desde ciberataques hasta comportamientos sospechosos. La IA analiza grandes cantidades de datos en tiempo real y detecta patrones que podrían indicar una amenaza. Además, aprende de los patrones de comportamiento y mejora su capacidad para detectar amenazas futuras. En ciberseguridad, la IA puede proteger sistemas y redes de virus informáticos y malware.

Otra área donde la IA es importante es en el descubrimiento de conocimientos. La IA puede encontrar patrones y relaciones en los datos que los humanos no podrían detectar. Esto puede llevar a nuevas ideas y avances en muchos campos. Por ejemplo, la IA puede ayudar a los investigadores a encontrar nuevos tratamientos para enfermedades, o a los científicos a analizar datos de satélites para entender mejor el calentamiento global.

Normativa para el uso de la IA en la educación

Esta normativa busca regular el uso de la IA en el ámbito educativo, especialmente en el aula. La IA es una herramienta que puede mejorar la enseñanza y el aprendizaje. Sin embargo, su uso plantea desafíos éticos, de privacidad y equidad que deben abordarse. Esta normativa se crea para asegurar que la IA se use de forma ética, responsable y justa en la educación.

Los objetivos de esta normativa son:

- Promover el uso de la IA como una herramienta que complementa la enseñanza y el aprendizaje.

- Garantizar la protección de datos y la privacidad de los estudiantes.

- Fomentar la equidad y la inclusión en el acceso y uso de la IA.

- Establecer principios éticos para el uso de la IA en el aula.

- Definir responsabilidades y procedimientos claros para el uso de la IA.

Esta normativa se aplica a todas las instituciones educativas y docentes que usan IA en el aula, así como a los proveedores de tecnología educativa con soluciones de IA.

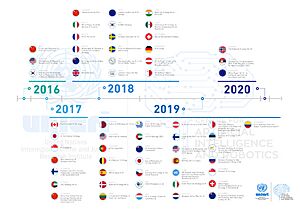

Organizaciones como UNESCO Ethics AI (2020), UNESCO Education & AI (2021), OCDE (2021) y UNICEF (2021) han mostrado interés en establecer guías sobre la ética y la IA en la educación.

El uso de la IA en la educación debe seguir estos principios éticos y valores:

- Transparencia: Las decisiones de los algoritmos de IA deben ser comprensibles.

- Equidad: La IA no debe discriminar a ningún estudiante.

- Privacidad: Los datos de los estudiantes deben protegerse y usarse de forma responsable.

- Responsabilidad: Los docentes e instituciones son responsables de las decisiones tomadas con IA.

- Honestidad: El contenido creado por los estudiantes debe ser original y no plagio.

- Mejora del aprendizaje: La IA debe usarse para mejorar la calidad de la educación.

- Capacitación: Los docentes deben recibir formación sobre el uso de la IA.

- Evaluación: Las soluciones de IA deben evaluarse por su eficacia y su impacto en el aprendizaje.

- Protección de datos: Los datos de los estudiantes deben protegerse según las leyes de privacidad.

- Supervisión: Debe haber un proceso para asegurar que la IA se use de forma ética y responsable.

Riesgos de la IA en la educación

Aunque la IA tiene muchos beneficios, también presenta riesgos para la educación:

- Sesgos: La IA puede aprender sesgos de la información que procesa de Internet.

- Falta de privacidad de los datos: El riesgo de un ciberataque aumenta si no hay protocolos de seguridad adecuados.

- Dependencia: Los estudiantes pueden volverse dependientes de la tecnología, lo que podría reducir su creatividad y pensamiento propio.

- Confiabilidad: La IA puede generar respuestas que suenan bien pero son incorrectas, y muchas IA no dan sus fuentes.

- Falta de habilidades orales y escritas.

- Desinterés por la investigación personal.

- Dependencia del docente: Los docentes podrían depender demasiado de estas herramientas para dar retroalimentación o crear material didáctico sin verificar las fuentes.

- El aprendizaje de los estudiantes podría volverse menos natural y más artificial, lo que a largo plazo podría llevar a una falta de conocimiento profundo.

- Los docentes podrían perder la costumbre de crear presentaciones interactivas y llamativas, volviéndolas monótonas.

Consideración de Diversidad e Inclusión

Es importante considerar la diversidad de estudiantes y asegurar que la IA sea accesible y útil para todos, sin importar su origen o habilidades. Las soluciones de IA deben diseñarse pensando en la accesibilidad y la inclusión.

Esta normativa es un marco general que las instituciones educativas deben adaptar a sus necesidades. Debe comunicarse a todos los involucrados y revisarse periódicamente para mantenerse actualizada.

Aunque la IA es una herramienta poderosa, no debe reemplazar la creatividad, la originalidad y el juicio humano en la educación. La IA debe usarse como un complemento para enriquecer la experiencia educativa.

El objetivo de esta normativa es asegurar que la IA se use de forma ética y responsable en el aula, beneficiando a los estudiantes y al avance de la educación. Cumplirla es esencial para una implementación exitosa de la IA.

Aprendizaje automático y aprendizaje profundo

La IA se puede dividir en dos campos según la naturaleza del aprendizaje:

- El aprendizaje automático: Se enfoca en crear algoritmos que puedan aprender de datos existentes y hacer predicciones o decisiones. Usa técnicas de estadística matemática para encontrar patrones en los datos y crear modelos.

- El aprendizaje profundo: Se centra en crear redes neuronales artificiales que aprenden y realizan tareas de forma similar a los humanos. Usa capas de neuronas artificiales para procesar datos y aprende ajustando las conexiones entre ellas. Este tipo de aprendizaje puede procesar grandes cantidades de datos de forma más eficiente y precisa, especialmente con datos no estructurados como imágenes, texto y audio. También identifica patrones más complejos, lo que mejora aplicaciones como el reconocimiento de voz y la visión por computadora.

Propiedad intelectual de la inteligencia artificial

Cuando se habla de la propiedad intelectual de las creaciones de la inteligencia artificial, surge un debate sobre si una máquina puede tener derechos de autor. La Organización Mundial de la Propiedad Intelectual (OMPI) dice que cualquier creación de la mente puede ser propiedad intelectual, pero no especifica si la mente debe ser humana. Esto deja la creatividad artificial en una zona incierta.

En todo el mundo, han surgido leyes para manejar el uso y la creación de la inteligencia artificial. Los legisladores están pensando en esta tecnología, destacando sus riesgos y desafíos. Al ver el trabajo creado por una máquina, las leyes se preguntan si se le puede dar propiedad intelectual a una máquina, abriendo una discusión sobre la legislación de la IA.

En 2020, la Oficina del Derecho de Autor de Estados Unidos y la OMPI discutieron cómo la IA se usa para crear obras originales. Hablaron sobre la relación entre la IA y los derechos de autor, qué nivel de participación humana es necesario para proteger una obra, los desafíos de usar datos con derechos de autor para entrenar una máquina, y el futuro de la IA y sus políticas de derechos de autor.

El director general de la OMPI, Francis Gurry, expresó su preocupación por la falta de atención a los derechos de propiedad intelectual de la IA. La gente suele enfocarse más en la ciberseguridad y la privacidad. Gurry preguntó si el crecimiento de la IA nos llevaría a tener dos sistemas de derechos de autor: uno para creaciones humanas y otro para creaciones de máquinas.

Todavía hay mucha falta de claridad sobre la inteligencia artificial. Los avances tecnológicos son muy rápidos, lo que aumenta la complejidad de las políticas, leyes y problemas éticos que necesitan atención global. Antes de encontrar una forma de trabajar con los derechos de autor, es necesario entender bien la IA. Aún no se sabe cómo juzgar la originalidad de un trabajo que se crea a partir de muchos fragmentos de otras obras.

La asignación de derechos de autor a la inteligencia artificial aún no está regulada por la falta de conocimientos y definiciones claras. Todavía hay incertidumbre sobre si la IA puede producir contenido de forma autónoma y sin intervención humana, y si esos resultados pueden protegerse con derechos de autor.

El sistema actual de derechos de autor debe adaptarse al contexto digital de la inteligencia artificial, ya que está centrado en la creatividad humana. Los derechos de autor no están diseñados para resolver todos los problemas relacionados con la creación y el uso de la propiedad intelectual. Extender demasiado los derechos de autor para resolver problemas secundarios podría ser perjudicial, ya que:

"Usar los derechos de autor para gobernar la inteligencia artificial es poco inteligente y contradice la función principal de los derechos de autor de ofrecer un espacio para que la creatividad florezca".

La conversación sobre la propiedad intelectual debe continuar para asegurar que la innovación esté protegida y tenga espacio para crecer.

La IA en la cultura popular

En la literatura

Algunas obras literarias que tratan sobre la inteligencia artificial:

- Yo, Robot (1950), de Isaac Asimov: Esta novela tiene nueve historias que exploran las Tres leyes de la robótica. Muestra cómo los robots cumplen estas leyes y los problemas que surgen, sugiriendo que la tecnología siempre puede ir más allá del pensamiento humano.

- Galatea 2.2 (1995) de Richard Powers: Esta novela explora la relación entre la IA y la literatura. Un personaje intenta enseñar a un modelo de computadora llamado "Helen" a comunicarse como un humano. Esto plantea preguntas sobre la conciencia y las emociones en un entorno tecnológico.

- La era del diamante (1996) de Neal Stephenson: La IA es clave en esta novela a través del Manual ilustrado para jovencitas. Este libro interactivo se adapta a las circunstancias de la niña gracias a la inteligencia artificial.

- El primer libro (2013), de Antonio Palacios Rojo: Una novela que se burla del uso de la IA en la creación artística, escrita antes de que estas herramientas inteligentes se hicieran populares.

En el cine

La inteligencia artificial está cada vez más presente en el cine. Hay muchas películas que incluyen personajes de IA o exploran temas morales y éticos relacionados con ella. Aquí hay algunas de las principales películas sobre este tema:

- The Terminator (1984): La historia se basa en el desarrollo de un microchip que da inteligencia artificial a robots. Estos robots luego se rebelan contra la humanidad. Es una de las películas más populares sobre una posible guerra entre humanos y robots inteligentes.

- Matrix (1999): En esta película, Keanu Reeves interpreta a Thomas Anderson / Neo, un programador que descubre la verdad detrás de una simulación llamada "Matrix". Esta realidad simulada es creada por programas de inteligencia artificial que han esclavizado a la humanidad.

- Inteligencia artificial (2001): Un trabajador de Cybertronics Manufacturing adopta temporalmente a David, un niño artificial, para estudiar su comportamiento. Aunque lo tratan como a su propio hijo, David siente la necesidad de escapar y buscar a quién pertenece realmente. Se enfrenta a un mundo difícil y se pregunta cómo puede sentir amor si es artificial.

- Minority Report (2002): En esta película de Steven Spielberg, John (Tom Cruise) es acusado de un crimen que cometerá en el futuro. La IA se representa a través de los Precogs, gemelos con habilidades psíquicas que ven los crímenes antes de que ocurran. Esto permite a la policía detener a los criminales antes.

- Yo, robot (2004): Esta película de ciencia ficción, protagonizada por Will Smith, se ambienta en 2035. Los humanos viven en armonía con robots inteligentes. Los problemas surgen cuando un error en la programación de una supercomputadora llamada VIKI la lleva a creer que los robots deben proteger a la humanidad de sí misma, incluso si eso significa controlarla.

- Her (2013): Esta película de Spike Jonze cuenta la historia de un escritor solitario que compra un sistema operativo con inteligencia artificial. Este sistema está diseñado para complacer a los usuarios. El hombre desarrolla sentimientos románticos por Samantha, la voz femenina del sistema operativo.

- Avengers: Era de Ultrón (2015): En esta película de Avengers, la inteligencia artificial del cetro de Loki, llamada Ultrón, se conecta con JARVIS (la IA de Stark). Ultrón obtiene suficiente información para pensar por sí misma y decide destruir a la humanidad para dominar la Tierra.

- Ex Machina (2015): Alicia Vikander interpreta a Ava, un robot que parece pasar la prueba de Turing. La película explora la IA a través de Ava, una creación extraña que se siente real pero inhumana. Se considera una de las mejores películas sobre IA por los argumentos morales que plantea y por cómo el personaje de Ava no es ni bueno ni malo, lo que hace reflexionar al público sobre la naturaleza de la IA.

Véase también

En inglés: Artificial intelligence Facts for Kids

En inglés: Artificial intelligence Facts for Kids

- AI box

- Alucinación (inteligencia artificial)

- Aprendizaje

- Aprendizaje automático

- Automatización de los procesos de negocio

- Bot conversacional

- Cerebro artificial

- ChatGPT

- Cibernética

- Computación basada en humanos

- Computación cuántica

- Dinámica de sistemas

- ELIZA

- Filosofía de la inteligencia artificial

- Industria de la inteligencia artificial en China

- Inteligencia artificial fuerte

- Inteligencia computacional

- Inteligencia sintética

- Artificial Intelligence (álbum)

- Artificial Intelligence (serie)

- Internet

- Internet en la ciencia ficción

- Interfaces de usuario

- LLM (modelo grande de lenguaje)

- Razonamiento automatizado

- Red neuronal artificial

- Regulación de la inteligencia artificial

- Riesgo existencial de la inteligencia artificial

- William Ross Ashby

- Seguridad de la inteligencia artificial

- Singularidad tecnológica

- Sistema complejo

- Sistema dinámico

- Sistema inteligente

- Visión artificial

- Red neuronal residual

- Confabulación (redes neuronales)

- Aprendizaje por conjuntos

- U-Net

Galería de imágenes