Síntesis de habla para niños

La síntesis de voz es la forma en que las computadoras producen sonidos que parecen habla humana. Un sistema que hace esto se llama sintetizador de voz. Puede ser un programa de computadora (software) o un aparato físico (hardware). Un sistema de texto a voz (TTS) convierte el texto escrito en voz. Otros sistemas pueden convertir símbolos lingüísticos, como transcripciones de sonidos, en voz.

La voz sintetizada se puede crear uniendo pequeños trozos de voz grabada que se guardan en una base de datos. Algunos sistemas guardan sonidos muy pequeños, como los fonemas (sonidos básicos del lenguaje), lo que permite una gran variedad de sonidos, pero a veces no son tan claros. Para usos específicos, guardar palabras o frases completas puede dar una mejor calidad de sonido. Otra forma es que el sintetizador imite cómo funciona la garganta y la boca humanas para crear una voz "sintética" desde cero.

La calidad de un sintetizador de voz se mide por lo parecida que es a una voz humana y lo fácil que es entenderla. Los programas de texto a voz son muy útiles para personas con dificultades visuales o para leer, ya que les permiten escuchar textos en la computadora. Muchos sistemas operativos de computadoras tienen sintetizadores de voz incluidos desde los años noventa.

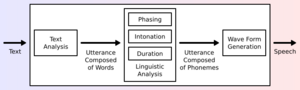

Un sistema de texto a voz (TTS) tiene dos partes principales: una parte inicial (front-end) y una parte final (back-end). La parte inicial convierte el texto (con números, símbolos y abreviaciones) en palabras escritas. Esto se llama "normalización del texto". Luego, esta parte asigna una transcripción de sonidos a cada palabra y divide el texto en unidades de ritmo, como frases u oraciones. La parte final, llamada "sintetizador", convierte esta información en sonido. En algunos sistemas, esta parte también calcula cómo debe sonar el tono y la duración de los sonidos para que la voz suene natural.

Contenido

Historia de la síntesis de voz

Mucho antes de que existiera la electrónica, algunas personas intentaron construir máquinas que imitaran el habla humana. Hay leyendas antiguas sobre "Cabezas de Bronce" que hablaban, relacionadas con figuras históricas como Silvestre II o Alberto Magno.

En 1779, un científico danés llamado Christian Kratzenstein construyó modelos de la garganta humana que podían producir los sonidos de las cinco vocales. Después, en 1791, Wolfgang von Kempelen de Hungría describió su "Máquina Parlante", que usaba fuelles y modelos de labios y lengua para producir tanto vocales como consonantes. Otros inventores como Charles Wheatstone (1837) y M. Faber (1857) también crearon máquinas similares.

En la década de 1930, los laboratorios Bell desarrollaron el vocoder, una máquina que analizaba el habla. A partir de este trabajo, Homer Dudley creó un sintetizador llamado The Voder, que se mostró en la Feria Mundial de Nueva York en 1939.

En los años 40 y 50, el Dr. Franklin S. Cooper y sus colegas en los laboratorios Haskins construyeron el "Pattern Playback". Esta máquina convertía imágenes de patrones de sonido (espectrogramas) en sonido. Con ella, los investigadores descubrieron cómo se perciben los sonidos del habla.

En los años 80 y 90, sistemas como DECtalk y los de los laboratorios Bell fueron muy importantes. Estos últimos fueron de los primeros en manejar varios idiomas. Al principio, los sintetizadores de voz sonaban robóticos y eran difíciles de entender. Aunque la calidad ha mejorado mucho, la voz sintetizada aún se puede distinguir de la humana.

Gracias a que son cada vez más baratos y accesibles, más personas pueden beneficiarse de los programas de texto a voz.

Dispositivos electrónicos y la voz artificial

Los primeros sistemas de síntesis de voz basados en computadoras aparecieron en los años 50. En 1961, los científicos John Larry Kelly Jr. y Louis Gerstman usaron una computadora IBM 704 para sintetizar voz. En un evento famoso, el sintetizador de Kelly reprodujo la canción "Daisy Bell". El escritor Arthur C. Clarke quedó tan impresionado que usó esta idea en su novela 2001: A Space Odyssey, donde la computadora HAL 9000 canta la misma canción.

En los años 70, empezaron a aparecer dispositivos electrónicos portátiles con síntesis de voz. Uno de los primeros fue la calculadora para personas con discapacidad visual "Speech+" en 1976. Otros dispositivos educativos, como el "Speak & Spell" de Texas Instruments (1978), también usaban esta tecnología. Los videojuegos también la adoptaron, como los juegos de arcade Stratovox y Berzerk en 1980.

¿Cómo funcionan los sintetizadores de voz?

Las cualidades más importantes de un sintetizador de voz son la "naturalidad" (qué tan parecida es a una voz humana) y la "inteligibilidad" (qué tan fácil es entenderla). El objetivo es que sean lo más naturales e inteligibles posible.

Existen dos tecnologías principales para crear las ondas de sonido de la voz sintética: la "síntesis concatenativa" y la "síntesis de formantes". Cada una tiene sus ventajas y desventajas.

Síntesis concatenativa

La síntesis concatenativa se basa en unir (concatenar) segmentos de voz que ya han sido grabados. Generalmente, esta técnica produce el sonido más natural. Sin embargo, a veces pueden aparecer pequeños ruidos o "fallos" en el sonido final debido a las diferencias entre los segmentos grabados y cómo se unen. Hay tres tipos principales de síntesis concatenativa:

Síntesis de selección de unidades

Este método usa grandes bases de datos de voces grabadas. Cuando se crea la base de datos, cada frase grabada se divide en partes más pequeñas, como sonidos (fonemas), sílabas, palabras o frases. Luego, se crea un índice de estas unidades de voz, basándose en características como el tono, la duración y los sonidos cercanos. Cuando se quiere generar una frase, el sistema busca en la base de datos las unidades que mejor se ajusten para crear esa frase.

La selección de unidades permite una mayor naturalidad porque usa menos procesamiento digital en la voz grabada. El procesamiento digital a veces hace que la voz suene menos natural. Los mejores sistemas de selección de unidades pueden sonar casi indistinguibles de voces humanas reales. Sin embargo, esto requiere bases de datos muy grandes, a veces de gigabytes de grabaciones. A veces, los algoritmos pueden elegir segmentos que no son los ideales, aunque haya mejores opciones.

Síntesis de difonos

La síntesis de difonos usa una base de datos de voz más pequeña que contiene todas las transiciones entre sonidos (difonos) de un idioma. Por ejemplo, en español hay unos 800 difonos. Solo se guarda un ejemplo de cada difono. Luego, el sistema ajusta el tono y la duración de estos difonos para que coincidan con la frase deseada. Este método puede sonar un poco robótico y tiene algunas de las "fallas" de la síntesis concatenativa. Su uso comercial ha disminuido, pero sigue siendo investigado.

Síntesis de dominio específico

Este tipo de síntesis une palabras y frases pregrabadas para crear oraciones completas. Se usa en situaciones donde el texto que el sistema debe decir es limitado, como los anuncios en el transporte público o los informes del tiempo. Es una tecnología sencilla de implementar y se ha usado en productos como calculadoras o relojes que hablan. La voz puede sonar muy natural porque las frases son limitadas y se graban con la entonación correcta.

Como estos sistemas están limitados a las palabras y frases de su base de datos, no sirven para cualquier texto. Solo pueden decir las combinaciones de palabras para las que fueron programados.

Síntesis de formantes

La síntesis de formantes no usa muestras de voz humana grabadas. En su lugar, el sonido se crea a partir de un modelo acústico que imita cómo se producen los sonidos en la garganta. Se ajustan parámetros como el tono y los niveles de ruido para crear una onda de sonido artificial.

Muchos sistemas de síntesis de formantes producen una voz artificial que suena robótica y no se confunde con una voz humana. Sin embargo, tienen ventajas sobre los sistemas concatenativos. La voz de formantes puede ser muy fácil de entender, incluso a velocidades altas, y evita los "fallos" de sonido. Esto es útil para personas con dificultades visuales que usan lectores de pantalla. Los sintetizadores de formantes son programas pequeños porque no necesitan una gran base de datos de muestras de voz. Por eso, se pueden usar en dispositivos pequeños con poca memoria. Además, como tienen control total sobre el sonido, pueden generar una gran variedad de tonos y entonaciones para expresar emociones o preguntas.

Ejemplos de síntesis de formantes incluyen el juguete "Speak & Spell" de Texas Instruments de los años 70 y algunos juegos de arcade de SEGA y Atari de los 80.

Síntesis articulatoria

La síntesis articulatoria usa modelos de la garganta humana y de cómo se mueven los órganos para producir el habla. El primer sintetizador articulatorio para experimentos de laboratorio fue desarrollado en los laboratorios Haskins en los años 70.

Actualmente, estos modelos no se usan mucho en sistemas comerciales, pero hay excepciones como el sistema gnuspeech, que es de código abierto y se basa en una articulación completa de la voz.

Síntesis basada en modelos HMM

Este método usa "modelos ocultos de Márkov" para crear voz. En este sistema, el sonido, el tono y la duración del habla se modelan al mismo tiempo. Las ondas de sonido se generan a partir de estos modelos.

Síntesis de ondas sinusoidales

Esta técnica crea voz reemplazando las bandas principales de energía del sonido (formantes) con tonos puros.

Retos en la síntesis de voz

Retos de la normalización de textos

Convertir texto a voz no es tan simple como parece. Los textos tienen palabras que se pronuncian diferente según el contexto, números y abreviaciones que necesitan ser "expandidas" correctamente. Por ejemplo, la palabra "proyecto" puede pronunciarse de dos maneras distintas en español, dependiendo de si es un sustantivo o un verbo.

La mayoría de los sistemas de texto a voz no "entienden" el significado del texto. Por eso, usan trucos para adivinar la pronunciación correcta, como mirar las palabras cercanas o usar estadísticas. Recientemente, han empezado a usar modelos para etiquetar las palabras según su función gramatical, lo que ayuda a resolver estas ambigüedades.

Decidir cómo leer los números es otro reto. El número "1325" puede leerse como "mil trescientos veinticinco", "uno tres dos cinco" o "trece veinticinco", dependiendo del contexto. Las abreviaciones también pueden ser ambiguas. Un buen sistema de texto a voz debe ser capaz de adivinar la forma correcta de leerlas.

Retos de texto a fonemas

Los sistemas de síntesis de voz usan dos métodos principales para saber cómo pronunciar una palabra a partir de su escritura:

- Diccionarios: Un diccionario grande guarda todas las palabras de un idioma y su pronunciación correcta. El programa busca cada palabra en el diccionario. Es rápido y preciso, pero falla si una palabra no está en el diccionario.

- Reglas: Se aplican reglas de pronunciación a las palabras. Funciona con cualquier texto, pero las reglas se vuelven muy complejas para palabras con pronunciaciones irregulares.

Casi todos los sistemas usan una combinación de ambos. Los idiomas con una escritura más regular (como el español) usan más reglas, mientras que los idiomas con muchas irregularidades (como el inglés) dependen más de los diccionarios.

Retos de evaluación

Evaluar los sistemas de síntesis de voz es difícil porque no hay un criterio universal. Diferentes organizaciones usan datos de voz distintos. La calidad también depende de cómo se grabó la voz original y de la facilidad para reproducirla. Sin embargo, desde 2005, algunos investigadores han empezado a usar datos de voz comunes para evaluar los sistemas.

Prosodia y contenido emocional

La prosodia se refiere al ritmo, la entonación y el acento del habla. Un estudio mostró que las personas pueden saber si alguien está sonriendo al escuchar su voz. Identificar estas características vocales que muestran emociones puede ayudar a que la voz sintetizada suene más natural. También es importante que el tono de la voz cambie según si es una pregunta, una afirmación o una exclamación.

Hardware especializado

A lo largo de la historia, se han creado chips y dispositivos específicos para la síntesis de voz. Algunos ejemplos incluyen:

- Primeras tecnologías (ya no disponibles): Chips como el Votrax SC-01A, General Instrument SP0256-AL2, National Semiconductor DT1050 Digitalker y los chips LPC de Texas Instruments.

- Actuales (en 2013): Magnevation SpeakJet, Epson S1V30120F01A100 (basado en DECtalk), y Textspeak TTS-EM.

Mattel

La consola de videojuegos Intellivision de Mattel, que era una computadora sin teclado, tenía un módulo de síntesis de voz llamado Intellivoice en 1982. Incluía un chip de síntesis de voz que guardaba una base de datos de palabras genéricas. Estas palabras se podían combinar para crear frases en los juegos de Intellivision.

SAM

También lanzado en 1982, Software Automatic Mouth (SAM) fue el primer sintetizador de voz comercial en software. Más tarde, sirvió de base para el Macintalk. SAM estaba disponible para computadoras Apple II, Atari y Commodore 64.

Atari

El primer sistema de síntesis de voz integrado en un sistema operativo fue para las computadoras Atari 1400XL/1450XL en 1983, usando un chip Votrax SC01. Estas computadoras eran poco comunes. Las computadoras Atari ST también venían con un programa de síntesis de voz.

Apple

El primer sintetizador de voz integrado en un sistema operativo fue MacInTalk de Apple, presentado con la computadora Macintosh en 1984. Al principio, la demostración requería más memoria de la que tenían las primeras Mac. A principios de los 90, Apple mejoró sus capacidades de texto a voz con computadoras más rápidas. También añadió el reconocimiento de voz. Hoy en día, el sistema de voz de Apple, PlainTalk, y VoiceOver (introducido en Mac OS X Tiger) son herramientas completas para personas con dificultades visuales. VoiceOver ofrece muchas voces y características como sonidos de respiración entre frases. El sistema operativo iOS de Apple (usado en iPhone, iPad) también usa VoiceOver para accesibilidad.

AmigaOS

El segundo sistema operativo en incluir capacidades avanzadas de síntesis de voz fue AmigaOS, lanzado en 1985. Tenía un sistema completo de voz en inglés americano, con voces masculinas y femeninas. El sistema estaba dividido en un dispositivo que modulaba los sonidos y una librería que traducía el texto a sonidos. AmigaOS también permitía a los usuarios reproducir texto desde la línea de comandos. Aunque se usaba en programas educativos, Commodore dejó de incluir la síntesis de voz a partir de AmigaOS 2.1.

Microsoft Windows

Los sistemas modernos de Microsoft Windows pueden usar componentes llamados SAPI para la síntesis y el reconocimiento de voz. Windows 2000 añadió Microsoft Narrator, una herramienta de texto a voz para personas con dificultades visuales. Hay programas de terceros que pueden leer texto de sitios web, correos electrónicos o documentos. Microsoft Speech Server es un paquete de voces para síntesis y reconocimiento basado en un servidor, diseñado para aplicaciones web y centros de llamadas.

Texto a voz (TTS) se refiere a la capacidad de las computadoras para leer texto. Un Motor TTS convierte el texto escrito en una representación de sonidos y luego en ondas de sonido que se pueden escuchar.

Android

La versión 1.6 de Android añadió soporte para los sintetizadores de voz (TTS).

Internet

En Internet, hay páginas web que permiten escuchar cualquier texto leído en voz alta. También hay herramientas que permiten que una página web ofrezca a sus visitantes la lectura en voz alta de su contenido. Existen aplicaciones y complementos que pueden leer mensajes de correo electrónico o páginas web. Algunos programas pueden narrar noticias RSS, convirtiéndolas en podcasts que los usuarios pueden descargar y escuchar en dispositivos portátiles.

Un campo creciente en Internet son las tecnologías de apoyo basadas en TTS, como 'Browsealoud' y Readspeaker, que ofrecen la función TTS a cualquier persona con acceso a un navegador de Internet. El proyecto Pediaphon, creado en 2006, permite una navegación web similar a la de Wikipedia con interfaz TTS.

Otros usos y sistemas

- Después del Intellivoice, los desarrolladores de videojuegos usaron la síntesis de voz con software, como en la narración de introducción del videojuego Super Metroid de Nintendo.

- Algunos lectores de libros electrónicos, como Amazon Kindle, Samsung E6 y PocketBook eReader Pro, incluyen síntesis de voz.

- El BBC Micro incorporó un chip de síntesis de voz de Texas Instruments.

- Algunos modelos de computadoras Texas Instruments de 1979 y 1981 (TI-99/4 y TI-99/4A) podían sintetizar texto a fonemas o recitar palabras y frases completas.

- OS/2 Warp 4 de IBM incluía VoiceType, un precursor de IBM ViaVoice.

- Sistemas de software libre y de código abierto como Linux tienen programas como Festival Speech Synthesis System y gnuspeech.

- Las unidades GPS de marcas como Garmin y TomTom usan síntesis de voz para la navegación en automóviles.

- Yamaha produjo un sintetizador en 1999, el Yamaha FS1R, que incluía capacidades de síntesis de formantes para frases cortas.

Lenguajes de marcado para síntesis de voz

Se han creado lenguajes especiales para indicar cómo debe interpretarse el texto para la voz, como el Speech Synthesis Markup Language (SSML), que se convirtió en una recomendación del W3C en 2004. Estos lenguajes son diferentes de los lenguajes de marcado de diálogo, que también incluyen etiquetas para el reconocimiento de voz.

Aplicaciones de la síntesis de voz

La síntesis de voz es una herramienta muy importante en las tecnologías de apoyo. Ayuda a eliminar barreras para personas con diferentes necesidades. Su uso más común ha sido en los lectores de pantalla para personas con dificultades visuales. Pero ahora, los sistemas de texto a voz también son usados por personas con dislexia y otras dificultades de lectura, así como por niños. También son útiles para personas con dificultades para comunicarse, a menudo a través de dispositivos que les ayudan a hablar.

Las técnicas de síntesis de voz se usan en productos de entretenimiento como juegos o animaciones. Por ejemplo, en 2007, Animo Limited anunció un software de síntesis de voz para la industria del entretenimiento, que permite generar narraciones y diálogos. En 2008, NEC Biglobe lanzó un servicio web que permitía a los usuarios crear frases con las voces de personajes de series animadas.

El texto a voz ha encontrado nuevas aplicaciones fuera del mercado de ayuda a personas con necesidades especiales. Por ejemplo, combinada con el reconocimiento de voz, permite interactuar con dispositivos móviles usando el lenguaje natural. También se ha usado para aprender un segundo idioma. Voki, por ejemplo, es una herramienta educativa que permite a los usuarios crear avatares que hablan con diferentes acentos.

API de síntesis de voz

Muchas empresas ofrecen API (interfaces de programación de aplicaciones) de TTS para que los desarrolladores puedan crear nuevas aplicaciones que usen esta tecnología. Entre ellas se encuentran AT&T, IVONA, Neospeech y Readspeaker. Los sistemas operativos Android y iOS de Apple también ofrecen API de TTS para el desarrollo de aplicaciones móviles.

Véase también

En inglés: Speech synthesis Facts for Kids

En inglés: Speech synthesis Facts for Kids

- Conversor texto-voz

- Lector de pantalla

- Lingüística computacional

- Podcast

- Procesamiento de lenguaje natural

- Reconocimiento de voz

- Sintetizador del habla

- VOCALOID (cantador)

- Utau