Edición de video para niños

La edición de vídeo es el proceso en el que una persona, llamada editor, organiza diferentes materiales como vídeos, fotos, gráficos, sonidos y efectos digitales. Todo esto se une para crear un programa final. Este programa puede ser para la televisión, para vender copias o para usarlo como base en otros proyectos.

Antes, la palabra "edición" se usaba solo para el vídeo y era diferente del "montaje" de películas. Pero hoy en día, con la ayuda de las computadoras, estos dos procesos se han vuelto muy parecidos.

En la era digital, la edición de vídeo se clasifica en cuatro tipos principales: por corte (o A/B roll), en línea y fuera de línea. Antes, cuando se usaba la edición lineal, había otros tipos, pero la edición no lineal, que permite acceder a cualquier parte del vídeo de forma rápida, los hizo desaparecer.

La edición de vídeo ha cambiado mucho con el tiempo. En 1958, se intentó copiar el método del cine de cortar y pegar trozos de cinta. En los años 70, llegó la edición lineal, que usaba varias grabadoras de vídeo. En 1988, apareció el primer sistema digital, y en 1992, el primero totalmente digital, gracias a las memorias flash y a los sistemas de compresión de vídeo. Ahora, los expertos no están seguros de cómo será el futuro, pero lo ideal sería que el cine y la televisión usaran un mismo sistema.

Contenido

¿Qué es la edición de vídeo?

Editar un vídeo significa organizarlo. Es como ir uniendo imágenes, quitando algunas, añadiendo efectos especiales, títulos o música. El objetivo es tener un producto listo para ser copiado o transmitido.

Al principio, todo este trabajo se hacía en una cinta especial llamada "máster de vídeo". Esta cinta se usaba para transmitir el programa o para hacer copias. Pero con la llegada de la edición digital en los años 80, se empezó a trabajar con archivos de computadora, creando lo que se llama un "máster digital de vídeo" (MDV).

Tipos de edición de vídeo

Existen diferentes formas de clasificar la edición de vídeo:

- Según cómo accedes al material:

* La edición no lineal te permite cambiar cualquier parte del vídeo (añadir o quitar) sin afectar el resto del trabajo. Es como editar un documento en tu computadora. * La edición lineal te obliga a rehacer todo el trabajo que viene después de la parte que modificaste. Es como si tuvieras que reescribir un texto desde el principio si cambias una frase en medio.

- Según la calidad del resultado final:

* La edición en línea es cuando el vídeo final tiene la calidad perfecta y está listo para ser usado. * La edición fuera de línea es cuando se crea una versión intermedia del vídeo, con una calidad más baja, solo para tener una idea de cómo quedará antes de hacer la versión final.

- Edición en cinta: Este tipo se hacía directamente en una cinta de vídeo, grabando una escena tras otra. La edición terminaba cuando se grababa la última escena.

- Según la técnica de grabación:

* La edición por ensamble se hacía grabando en una cinta de vídeo "virgen" (nueva). * La edición por inserto grababa solo la imagen, manteniendo el sonido y el código de tiempo original. Estos tipos de edición ya no se usan con los másteres digitales.

También hay otros criterios:

- Según las transiciones:

* La edición por corte es cuando el cambio entre una escena y otra es muy rápido y directo. * La edición A/B roll usa transiciones más suaves, como fundidos (la imagen se desvanece), cortinillas (una imagen "empuja" a la otra) o encadenados (una imagen se mezcla con la siguiente).

- La edición en línea (otra vez, pero con un significado diferente) es el proceso de volver a montar el vídeo con la máxima calidad después de haber hecho una edición fuera de línea. Se hace al final de la producción.

- La edición en la nube usa internet para trabajar con vídeos a distancia, en equipo o para cosas urgentes, como editar eventos deportivos en vivo usando copias de vídeo de menor calidad.

Diferencias entre "montaje" y "edición"

Aunque a veces se usan como si fueran lo mismo, "montaje" y "edición" se referían a procesos distintos. Es como decir "cuadro" y "fotograma" o "grabación" y "filmación", que también tienen sus diferencias. La razón para distinguirlos es que cada palabra nos dice qué tipo de trabajo, materiales y calidad se usaban.

El montaje se hacía con películas de cine (de 16, 35 o 70 mm). Se usaban procesos químicos para hacer copias y trabajar con ellas, lo que implicaba líquidos, espacios grandes y tiempos de espera.

La edición es un término que se usa para los soportes magnéticos, como cintas, memorias flash o discos duros. Se trabaja con material grabado electrónicamente para crear una cinta o un archivo de computadora. La edición suele ser más sencilla y barata que el montaje, aunque antes la calidad de imagen era menor, hasta que llegó el siglo XXI.

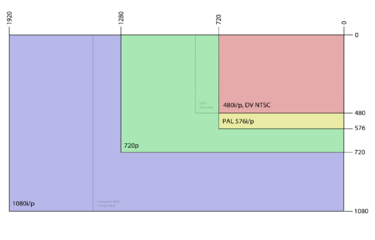

La diferencia de calidad se notaba al imprimir las imágenes. Un fotograma de cine de 35 mm impreso a buena calidad podía ocupar casi media hoja A4. En cambio, un cuadro de vídeo PAL impreso con la misma calidad sería del tamaño de un sello de correos, porque tenía menos líneas de definición.

En el siglo XXI, los dos sistemas (cine y vídeo) se han unido. Ambos pueden ser digitales y se manejan con equipos muy parecidos. Sin embargo, a veces se siguen usando métodos distintos para el cine y el vídeo por razones de costo o preferencia.

Los primeros desafíos

Cuando la televisión apareció en los años 20, el cine era la única forma de organizar las escenas. El proceso era así: después de grabar, se hacía una copia positiva de la película para trabajar con ella. Una vez que el montaje estaba listo, se anotaban los números de los fotogramas. Con esos números, se cortaban los negativos originales y se hacían copias de las partes elegidas. Finalmente, se unían esas partes para crear una cinta limpia. A esa cinta se le añadían títulos, efectos y sonido. El resultado era una única cinta maestra, de la que se hacían muchas copias.

La televisión, al principio, solo podía transmitir en vivo. Intentaron grabar la señal como se grababa el sonido, pero la imagen necesitaba mucha más capacidad, incluso en blanco y negro. Así que, hasta que encontraron una solución, los programas se hacían en vivo, desde un disco de cristal (como los discos de vinilo) o proyectando una película de cine mientras una cámara de televisión la grababa y transmitía. Estas últimas soluciones eran lentas y difíciles de cambiar. Fue con la llegada del vídeo en 1956 cuando se pudo hacer algo parecido al montaje de cine.

En 1956, la empresa Ampex creó la primera grabadora de vídeo, llamada Cuadruplex. Esta máquina grababa en grandes cintas magnéticas de 5 cm de ancho que se movían muy rápido. A pesar de ser grande y cara, esta grabadora permitió guardar las emisiones de televisión y ofreció muchas ventajas sobre el cine: se podía grabar sonido e imagen al mismo tiempo, no había que esperar el revelado y los equipos eran más baratos. Pero el vídeo tenía sus propios problemas. La calidad de imagen era mucho más baja que la del cine, y era imposible saber dónde empezaba una escena en una cinta magnética con solo mirarla, a diferencia de los fotogramas de cine que sí se veían a contraluz. Además, había muchos formatos de cintas de vídeo diferentes, lo que complicaba las cosas. A pesar de todo, el vídeo seguía siendo más económico.

Evolución de la edición de vídeo

Primera edición no lineal

Cuando llegaron las cintas de vídeo, los editores intentaron copiar el montaje de cine. Era el único método que conocían. Cortar con tijeras y pegar con pegamento permitía acortar o alargar escenas. Para facilitar esto, Ampex lanzó en 1958 una máquina para unir cintas. El proceso era: marcar las escenas con partículas metálicas, cortar la parte deseada, poner los trozos en la máquina y unirlos con un pegamento especial. Luego, la cinta pegada se volvía a poner en la grabadora.

Esta era una edición no lineal porque permitía cambiar cualquier parte sin afectar lo anterior o lo siguiente. Sin embargo, usar estas máquinas no era muy eficiente por su poca precisión y el tiempo que tomaba sacar la cinta, manipularla y volver a colocarla.

Edición lineal

Los problemas de la edición no lineal se resolvieron usando dos o más grabadoras de vídeo (VTR). Una grabadora era la "fuente" o "reproductor", que mostraba la imagen que se iba a usar. La otra era la "grabadora" o "recorder", que creaba la edición en una "cinta máster". Ambas tenían monitores para saber dónde empezar a grabar.

La edición lineal perdía un poco de calidad (aproximadamente un 8%) porque se hacía una segunda copia, pero resolvía el problema de ver las escenas exactas sin tener que desmontar nada. Las máquinas podían conectarse directamente para hacer una edición por corte. También se podían conectar varias grabadoras a un mezclador de vídeo para hacer cortinillas o fundidos, creando la edición A/B roll. Este nuevo sistema tardó unos 15 años en ser adoptado.

Para ahorrar tiempo al buscar la escena exacta, en 1967 la empresa EECO creó cintas con un código de tiempo que mostraba la hora, minuto, segundo y cuadro. Cinco años después, se creó un estándar para estos códigos. Esto permitía ir directamente al punto deseado en la cinta. Además, las mejoras electrónicas llevaron a la creación de las mesas de edición, que sincronizaban las grabadoras y permitían ver el resultado antes de grabarlo. Esto ahorró mucho tiempo de trabajo.

Este sistema permitía tres nuevas formas de edición lineal: la "Playrec" (añadir código de tiempo a una cinta virgen), el "Assemble" y el "Inserto". Todos estos desaparecerían con la llegada de los equipos digitales.

Desafíos e inconvenientes

- Solo se podía cambiar la duración de la última escena sin afectar las anteriores. Si se modificaba una parte intermedia, había que rehacer toda la edición desde ese punto.

- No se guardaba un historial, así que si se repetía la edición, había que volver a elegir todos los detalles.

- Si no se tenía la cinta máster, las copias se hacían de otras copias, perdiendo calidad.

- Las decisiones sobre las normas para transmitir la señal de televisión crearon muchos formatos diferentes (NTSC, PAL, SECAM). Esto significaba que las salas de edición necesitaban grabadoras de varios formatos. También era complicado pasar películas de cine a formato de vídeo.

Equipamiento necesario

Los equipos para la edición lineal podían ser desde dos monitores y dos grabadoras, hasta salas muy costosas con máquinas especiales para efectos. Una sala completa podía costar entre 500.000 y un millón de dólares en los años 90, y alquilarla entre 300 y 1000 dólares la hora. Para ahorrar, se crearon salas más sencillas, llamadas salas "fuera de línea" (off-line), que costaban entre 20.000 y 40.000 dólares y se alquilaban entre 50 y 150 dólares la hora. La idea era preparar el proyecto lo mejor posible antes de usar la sala cara. Así nacieron las "preediciones" o ediciones fuera de línea, que eran una cinta de vídeo con una idea del resultado final.

La idea de dividir el trabajo en dos salas no siempre funcionaba bien. Los equipos de la sala fuera de línea a veces eran muy básicos, y las listas de decisiones de edición no siempre eran compatibles con los equipos de la sala en línea. Por eso, muchas decisiones tenían que volverse a tomar en la sala más cara.

Edición no lineal

La edición no lineal moderna se diferencia de la antigua por tres cosas:

- Usa computadoras en algún momento del proceso.

- Permite editar sin un orden fijo, incluso duplicando escenas, y saltar a cualquier parte del vídeo, por eso se llama "acceso aleatorio".

- Ya no son necesarios los procesos de "assemble", "pistado de cinta" o "inserto". Las instrucciones se guardan en un archivo de computadora y se pueden cambiar y duplicar cuantas veces se quiera.

La edición no lineal buscaba reemplazar las salas fuera de línea, que no habían funcionado como se esperaba, pero pronto demostró ser capaz de mucho más.

El primer intento de crear un sistema de edición no lineal fue el CMX 600 en 1988. Usaba discos magnéticos para grabar imágenes de forma híbrida (no totalmente digital). Con un lápiz electrónico, se podía acceder a cualquier escena, borrarla, alargarla o acortarla. Sin embargo, su alto costo (200.000 dólares) y su programación no tan pulida impidieron que fuera un éxito comercial.

Primera generación (por videocinta)

Estos equipos tenían una grabadora y varias reproductoras (hasta 27). El editor seleccionaba las escenas, y el sistema las organizaba, poniendo cada grabadora en el inicio de cada escena y reproduciéndolas en el orden correcto. Si había más escenas que grabadoras, la primera grabadora libre se movía a la siguiente escena.

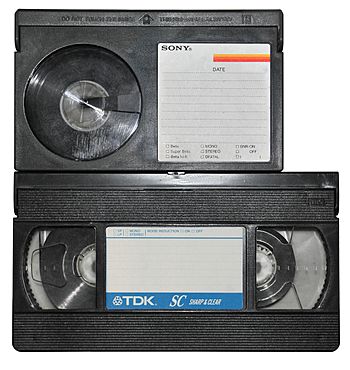

Estos equipos, basados en cintas VHS o Betamax, aparecieron a principios de los 80. Ofrecían una lista de decisiones de edición, una lista de corte de negativo y una copia para ver el resultado. También crearon un nuevo tipo de máster, el máster digital de vídeo (MDV), que era un archivo de computadora que se podía duplicar sin perder calidad.

Aunque tuvieron éxito, presentaban problemas: había que pasar el material a cintas de vídeo antes de editar, y a veces las máquinas no tenían tiempo de llegar a la siguiente imagen, lo que se llamaba "colapso". Por eso, eran más adecuados para editar series o películas que para noticias o anuncios.

Segunda generación (por videodisco)

En 1984, George Lucas lanzó el EditDroid, que usaba cuatro reproductores de videodisco. Fue el primero en incluir una interfaz gráfica con una línea de tiempo. Aunque no se vendieron muchas unidades, su tecnología fue comprada por empresas como AVID y Sony.

El EditDroid usaba discos láser. Con el tiempo, la tecnología mejoró y aparecieron discos láser de doble cara y reproductores con dos cabezales, lo que redujo el número de máquinas necesarias a solo dos.

Otros sistemas como el CMX 6000 (1988) y el Epix (1989) le siguieron. Todos ellos redujeron los problemas de "colapso" y mejoraron el tiempo de acceso a las imágenes.

Los inconvenientes de esta generación eran: el tiempo que tomaba pasar el material a los discos, la poca cantidad de material disponible y la necesidad de añadir más equipos para efectos visuales. A pesar de esto, estos sistemas se usaron hasta bien entrados los años 90.

Tercera generación (por disco magnético)

En 1988, apareció el primer editor no lineal que guardaba todo el material en una computadora. Se llamó EMC2. Usaba un algoritmo de compresión de imágenes y podía almacenar hasta 24 horas de material. A este sistema le siguieron otros como el Avid Media Composer.

La tercera generación trajo muchas novedades:

- Acceso realmente rápido a cualquier parte del material.

- Se podía guardar un historial completo de todas las decisiones de edición.

- Se podían crear efectos como títulos con el mismo equipo.

Sin embargo, tenía desventajas: el tiempo que tomaba procesar los efectos y las copias finales, la calidad de imagen no era muy alta (o el espacio de almacenamiento se reducía mucho si se trabajaba con alta calidad) y la necesidad de digitalizar el material de vídeo o cine antes de editarlo, lo que causaba pérdida de calidad y tiempo.

Estos sistemas eran muy caros. Una hora de material podía ocupar 8.2 gigabytes, y un gigabyte costaba mucho dinero en esa época. Por lo tanto, un equipo para editar una hora de programa podía costar más de medio millón de dólares solo en almacenamiento.

Cuarta generación (los formatos de compresión para vídeo)

Con las ventajas de la informática, los expertos pensaron que las salas de edición "fuera de línea" y "en línea" se unirían en un solo equipo, capaz de hacer todo con alta calidad. Desde 1992, surgieron productos que podían manejar el material de cámara directamente, pero no eran buenos para efectos visuales grandes.

El Avid Media Composer 8000, que apareció en 1999, podía producir anuncios y programas de televisión con suficiente calidad para reemplazar a las dos salas. Esto fue posible gracias a nuevos algoritmos de compresión, la reducción de precios del almacenamiento y las mejoras en los programas de edición de imagen y sonido.

Aun así, esta generación tenía limitaciones:

- A menudo, todavía era necesario pasar el material al sistema, porque muchas cámaras grababan en formatos especiales.

- No tenían suficiente potencia para hacer todos los efectos. Se necesitaban máquinas especiales para efectos complejos.

- La edición de cine digital parecía lejana por la alta resolución necesaria. Una hora de película en alta resolución ocupaba muchísimos gigabytes, lo que era muy caro.

Quinta generación (gestor de medios digitales)

La quinta generación de edición digital se distingue porque puede trabajar con el material de cámara digital en su formato original (Raw) y crear personajes virtuales a partir de movimientos reales. Esto hizo realidad el concepto de "gestor de medios digitales", un sistema capaz de crear y manejar casi cualquier efecto, por complicado que fuera. Por ejemplo, el Avid Film Composer podía trabajar con resolución 4K. Tres estaciones de la familia Media Composer, trabajando en red, pudieron crear un personaje totalmente digital, Gollum, y manejar 128.000 GB de imágenes de la trilogía de "El hobbit". Esto se logró gracias a varios factores:

Primero, las mejoras en las memorias flash permitieron almacenar 100 GB en una sola tarjeta. Esto llevó a cámaras como la Red One, que podían grabar digitalmente con calidad de cine.

Segundo, la llegada de procesadores con varios núcleos hizo posible realizar muchas operaciones visuales por segundo. Así, un mismo sistema podía hacer todo tipo de efectos. Además, las memorias RAM y las tarjetas gráficas se abarataron, haciendo que incluso los equipos domésticos tuvieran suficiente potencia para editar televisión de alta definición.

Finalmente, la llegada de la Televisión Digital Terrestre (TDT) también ayudó. Esto trajo la televisión de alta definición y la eliminación de los equipos analógicos antiguos.

El futuro de la edición de vídeo

En 1990, casi todos estaban de acuerdo en cómo sería la edición de vídeo en el futuro. Sin embargo, en el siglo XXI, los expertos no están seguros del camino que seguirá. No dudan de que seguirá existiendo, sino de cómo evolucionará.

El cine enfrenta desafíos por la competencia de otros medios. Sería bueno que la televisión y el cine usaran un mismo formato y que la edición fuera idéntica en todos los detalles, incluyendo el formato de pantalla ancha.

Sin embargo, hay muchos intereses que podrían impedir esta unión. El cine siempre ha intentado diferenciarse de la televisión, por ejemplo, lanzando películas en 3D o ampliando la pantalla. Por eso, es posible que los estudios de cine creen nuevas normas para seguir siendo diferentes. Otros expertos creen que la televisión, tal como la conocemos, tiene los días contados debido a la potencia de los dispositivos móviles, lo que haría que solo existiera un formato, el del cine. Lo cierto es que con los teléfonos con cámara, la cantidad de formatos de vídeo se ha multiplicado.

Más información

Véase también

En inglés: Video editing Facts for Kids

En inglés: Video editing Facts for Kids